Der Lehrstuhl PEASEC an der TU Darmstadt untersucht, wie Jugendliche bei der Erkennung von Falschinformationen auf Videoplattformen unterstützt werden können: Interview-Studie mit App-Test bestätigt Indikator-Ansatz

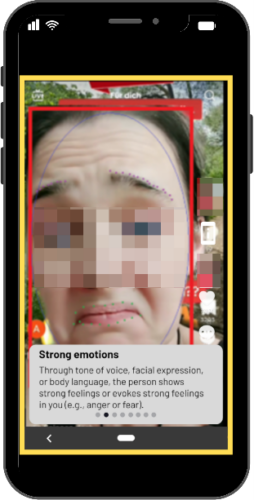

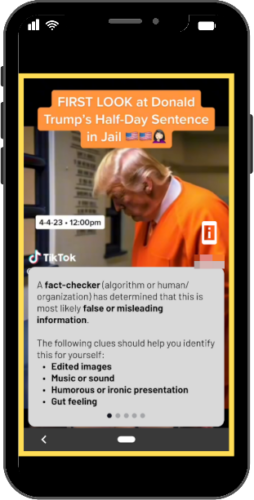

Ein Forschungsteam der Technischen Universität Darmstadt hat erstmals untersucht, wie man Jugendliche auf der Kurzvideoplattform TikTok bei der Erkennung von Desinformation unterstützen kann. Ergebnis: Die Jugendlichen akzeptieren Warnhinweise besonders gut, wenn diese nachvollziehbar begründet werden. Anzeichen für Desinformation auf einer Videoplattform lassen sich zum Beispiel in Kommentaren oder bei den Urheber-Informationen finden, und auch emotionalisierende Musik, Mimik und Gestik können ein Hinweis auf Desinformation sein. Veröffentlicht werden die Erkenntnisse des Teams im Mai dieses Jahres auf der führenden Konferenz für Mensch-Maschine-Interaktionen, der ACM CHI Conference on Human Factors in Computing Systems. Der wissenschaftliche Artikel ist hier verlinkt.

Die qualitative Studie ist aus mehreren Gründen besonders beachtenswert: Zum einen ist TikTok die international führende Kurzvideoplattform, und TikTok-Inhalte werden auch oft in anderen sozialen Medien geteilt. Zum anderen gelten Jugendliche als Schlüsselgruppe bei der Bewertung von Desinformation. Außerdem gilt der gezielte Hinweis auf Verdachtsmomente für Falschinformationen (Indikator-Ansatz) als besonders vielversprechend, um die Verbreitung von Desinformation wirksam zu reduzieren.

Interviews und Praxistest mit der App

Die Autor*innen führten Gespräche mit insgesamt 39 Jugendlichen im Alter zwischen 13 und 16 Jahren, die durch eine Kooperation mit einer Darmstädter Schule und dem Haus der digitalen Medienbildung Darmstadt rekrutiert werden konnten: Im ersten Schritt befragten die Wissenschaftler*innen die Jugendlichen zu möglichen Indikatoren. Basierend auf den Aussagen der Jugendlichen entwickelte das Team einen App-Prototypen mit aktuellen Video-Inhalten und entsprechenden Warnhinweisen. Der Prototyp wurde anschließend mit den Jugendlichen getestet. Insgesamt sahen die Jugendlichen eine Unterstützung durch Warnhinweise als hilfreich an, solange diese auf aussagekräftigen Indikatoren beruhten. Dazu zählten für die Jugendlichen zum Beispiel Hinweise in den Kommentaren oder zu den Urhebern von Informationen. Teilweise vertrauten die Jugendlichen den Hinweisen des Algorithmus allerdings zu stark und unterschätzten die negativen Auswirkungen, die falsche Warnmeldungen haben können

Die Forschungsarbeit entstand im Rahmen der am Lehrstuhl „Wissenschaft und Technik für Frieden und Sicherheit (PEASEC)“ an der Technischen Universität Darmstadt angesiedelten Projekte: dem vom Bundesministerium für Bildung und Forschung (BMBF) geförderten Projekt NEBULA: Nutzerzentrierete KI-basierte Erkennung von Fake News und Fehlinformationen, dem BMBF-Verbundprojekt CYLENCE: Strategien und Werkzeuge gegen Cybermobbing und Hassbotschaften und im Rahmen des ATHENE Forschungsbereichs Secure Urban Infrastructures (SecUrban).

Katrin Hartwig, Tom Biselli, Franziska Schneider, Christian Reuter (2024)

From Adolescents‘ Eyes: Assessing an Indicator-Based Intervention to Combat Misinformation on TikTok

Proceedings of the 2024 CHI Conference on Human Factors in Computing Systems .

Weitere Informationen zu den Arbeiten der Forschergruppe finden sich im Internet unter https://peasec.de/2024/chi-2024/